Google ha anunciado el lanzamiento de Project Gameface en Android. Este “ratón” permite controlar aplicaciones y juegos con movimientos de la cara y expresiones faciales.

Ahora está disponible en código abierto para los desarrolladores de Android, con el objetivo de mejorar la accesibilidad en estos dispositivos.

Durante su evento anual para desarrolladores, Google I/O, la compañía presentó sus últimas novedades en Inteligencia Artificial (IA) y Android.

PROJECT GAMEFACE ES UNA HERRAMIENTA DE CÓDIGO ABIERTO

Entre ellas, destacó la tecnología de Project Gameface en Android. Esta herramienta permite a los usuarios controlar aplicaciones con la cara y expresiones faciales.

Project Gameface es una herramienta de código abierto que Google presentó en el evento Google I/O del año pasado.

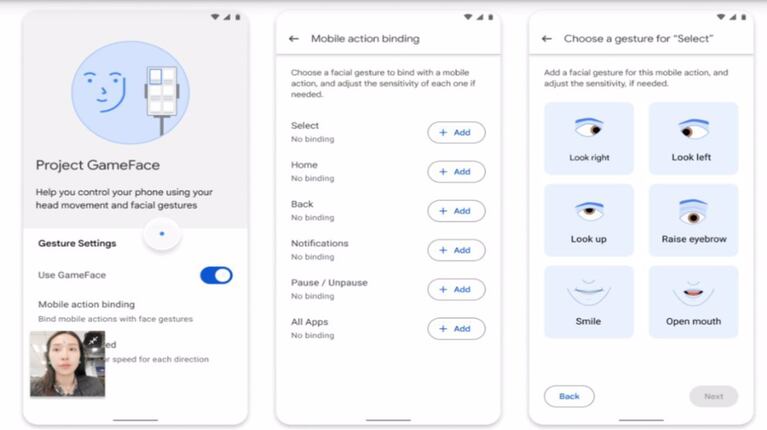

Google ha lanzado Project Gameface en Android. Este “ratón” permite a los usuarios controlar el cursor de un ordenador con movimientos de la cabeza y muecas.

SE MEJORARÁ LA ACCESIBILIDAD

Por ejemplo, los usuarios pueden levantar las cejas para hacer clic o abrir la boca para mover el cursor.

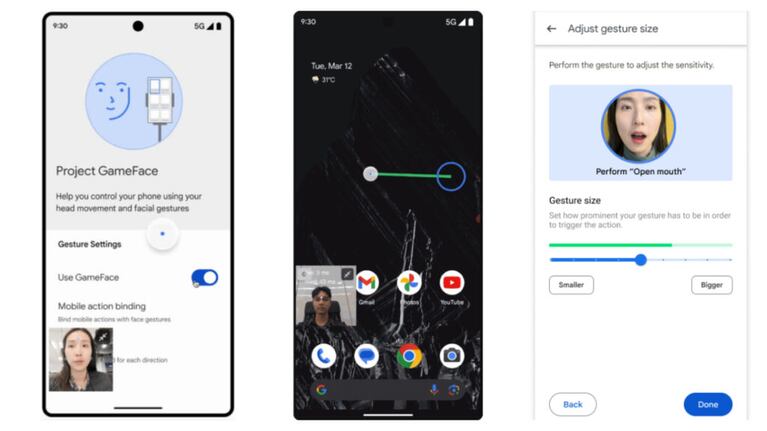

Esta tecnología está diseñada para mejorar la accesibilidad, especialmente para personas con dificultades de movimiento o enfermedades como la distrofia muscular.

Google ha abierto el código de esta tecnología para que los desarrolladores puedan crear aplicaciones de Android usando este sistema de control.

UN CONTROL INTUITIVO Y PERSONALIZADO

La compañía explicó en su blog que han adaptado la idea de mover el cursor del ordenador con la cabeza e integrado esta tecnología en los ‘smartphones’ Android.

Esta tecnología permite usar la cámara frontal del dispositivo para analizar expresiones faciales y movimientos de la cabeza, traduciéndolos en un control “intuitivo y personalizado”.

Los usuarios pueden personalizar su experiencia, ajustando las expresiones faciales, el tamaño de los gestos y la velocidad del cursor.

SE PODRÁ CREAR UN NUEVO CURSOR

Google ha integrado Project Gameface en Android utilizando el servicio de accesibilidad del sistema operativo para crear un nuevo cursor.

Además, han aprovechado la API de detección de puntos de referencia faciales de MediaPipe.

Esta API reconoce 52 gestos faciales, como levantar las cejas, abrir la boca o guiñar un ojo, permitiendo mapear y controlar una amplia gama de funciones.

DETECCIÓN DE PUNTOS DE REFERENCIA

Además, han aprovechado la API de detección de puntos de referencia faciales de MediaPipe.

Las aplicaciones para Android que incluyan Project Gameface permitirán, además de jugar, escribir en plataformas de mensajería instantánea controlando el cursor con movimientos de la cabeza.

Google ha hecho el código de Project Gameface de código abierto en Github, permitiendo a cualquier usuario implementarlo en sus aplicaciones y hacer más accesibles los dispositivos Android.

Fuente: EP.