Nvidia lanza la plataforma Nvidia Blackwell, formada por el nuevo chip “más potente del mundo” GPU B200, con hasta 208.000 millones de transistores, y por el superchip GB200 Grace Blackwell.

Este último combina dos GPU B200 con una CPU Nvidia Grace, para tener un rendimiento hasta 30 veces más potente para cargas de trabajo de inferencia de modelos grandes de lenguaje (LLM).

La tecnológica informó sus novedades en su conferencia de desarrolladores de IA Nvidia GTC.

NVIDIA APUNTA A LA NUEVA ERA INFORMÁTICA

En el evento ha subrayado su intención de impulsar “una nueva era de informática” de la mano de sus nuevos chips, diseñados para impulsar la IA generativa en tiempo real.

Para alcanzar dicha funcionalidad, se apela a la utilización de modelos de lenguaje de gran tamaño con “billones de parámetros”, a un coste y consumo de energía “hasta 25 veces menor”.

En este sentido, la compañía indicó que la arquitectura de GPU Blackwell se ha desarrollado con seis tecnologías enfocadas en la computación acelerada.

LA REPERCUSIÓN DE BLACKWELL EN VARIOS RUBROS

Así, sus nuevos chips desbloquearán avances en diversos sectores.

Ejemplo de estos son lugares como el procesamiento de datos, la simulación de ingeniería, la automatización del diseño electrónico, la computación cuántica y la IA generativa.

Como indicó Nvidia en un comunicado, una de las tecnologías de Blackwell es el chip “más potente del mundo”, GPU B200, que está equipado con 208.000 millones de transistores.

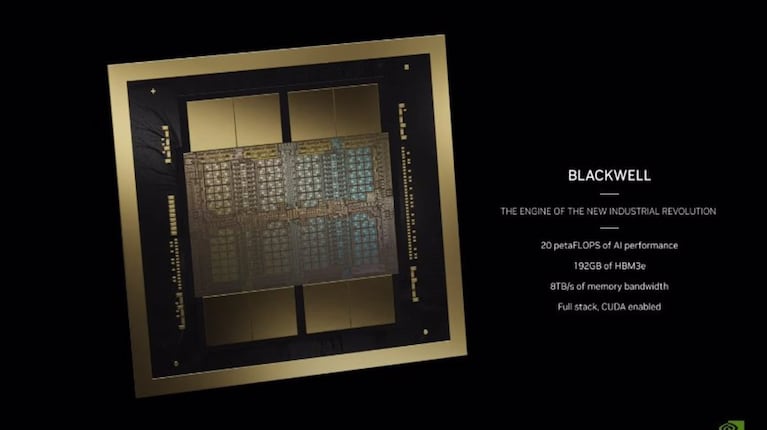

20 PETAFLOPS DE RENDIMIENTO IA

Es preciso contrastar a este último con los 80.000 millones de transistores de su antecesor, el chip H100.

Asimismo, alcanza los 20 petaFLOPS de rendimiento de IA y tiene un ancho de banda de 8TB por segundo.

También el “superchip” Nvidia GB200 Grace Blackwell, que conecta dos GPU B200 con una CPU Nvidia Grace a través de una interconexión de chip a chip NVLink.

UN SUPERCHIP CON 4 NANÓMETROS TSMC

Con dicha interacción los chips pueden comunicarse entre sí a velocidades de hasta 10 terabytes por segundo “en una única GPU unificada”.

Este “superchip” está fabricado con arquitectura Blackwell y mediante un proceso de 4 nanómetros TSMC personalizado.

Este “superchip” es un “componente clave del nuevo sistema Nvidia GB200 NVL72. Tiene 30 veces más rendimiento para cargas de trabajo de inferencia de LLM que la capacidad de la GPU H100.

UN SISTEMA DE MÚLTIPLES NODOS

Asimismo, es más eficiente, ya que reduce el consumo de energía y, por tanto, el coste.

Nvidia GB200 NVL72 es un sistema de múltiples nodos, refrigerado por líquido a escala de rack diseñado para hacer las cargas de trabajo que requieran un uso intensivo de computación.

Para ello, combina 36 superchips GB200 Grace Blackwell, que incluyen 72 GPU Blackwell B200 y 36 CPU Grace, interconectadas por NVLink de quinta generación.

NVIDIA BUSCA AVANCES TRANSFORMADORES

Se indicó también que, para mayor rendimiento de la IA, los sistemas con tecnología GB200 se pueden conectar con sus plataformas Nvidia Quantum-X800 InfiniBand y Spectrum-X800 Ethernet.

Con estas, se podrán ofrecer redes avanzadas, con las que podrán alcanzar velocidades de hasta 800 Gb por segundo.

Como recordó el fundador y director ejecutivo de Nvidia, Jesen Huang, Nvidia lleva trabajando “tres décadas” para desarrollar nuevas tecnologías relacionadas con la computación acelerada.

Su principal objetivo es “permitir avances transformadores como el aprendizaje profundo y la IA”.

EMPRESAS YA CONFIRMARON QUE ACUDIRÁN A BLACKWELL

Ahora, con la nueva plataforma Blackwell, han conseguido desarrollar “el motor que impulsará la nueva revolución industrial”.

Nvidia confirmó a su vez que diversas organizaciones del sector adoptarán la arquitectura Blackwell.

Tal es el caso de Amazon Web Services, Dell Technologies, Google, Meta, Microsoft, OpenAI, Oracle, Tesla y xAI.

ENTRENAR LOS MODELOS CON BLACKWELL

El director ejecutivo de Alphabet y Google, Sundar Pichai, determinó que continuarán invirtiendo en infraestructura para potenciar sus productos y servicios.

Es por esto que aguardan “llevar las capacidades innovadoras de la GPU Blackwell a clientes y equipos de la nube en Google, incluido Google DeepMind, para acelerar descubrimientos futuros”.

De la misma forma se pronunció el director ejecutivo de Meta, Mark Zuckerberg, quien adelantó que esperan utilizar Blackwell para “ayudar a entrenar los modelos Llama de código abierto”.

De esa forma, el dueño de la empresa aseguró que de esa manera van a poder “construir la próxima generación de Meta AI y productos de consumo”.

Fuente: EP.